Stream数据流处理模式

使用物化视图实时查询微服务

分布式系统架构由于其灵活性、可扩展性和容错性而变得越来越流行。然而,实时查询来自多个微服务的数据可能具有挑战性,因为它可能需要复杂且耗时的数据检索操作。物化视图与命令查询职责分离(CQRS) 模式相结.

Java中的流畅接口和构建模式之间的区别

流畅接口Fluent Interface 是一种面向对象的 API 设计,它允许我们以可读和直观的方式将方法调用链接在一起。要实现它,我们需要声明从同一类返回对象的方法。因此,我们将能够将多个方法调用.

Apache Flink 是实时流处理的行业标准

在 Decodable,我们长期以来一直认为Apache Flink是最好的流处理系统,在满足世界上一些最大和最复杂的企业(如 Netflix、Uber、Stripe 等)的需求方面有着良好的记录。未.

Rust 可组合性比较差

我爱锈。我希望他们能花更多时间让它真正适用于非 hello-world 用例。迭代Rust 有一个很好的迭代语法:for x in &mut something { *x = (*x) * 2;.

JEP 431:序列化集合

序列化集合:有顺序的集合、有序集合。有序集合是其Collection元素具有定义的顺序的集合。集合中都有一个明确定义的第一个元素、第二个元素等等,直到最后一个元素。将引入统一的 API 来访问它的第一.

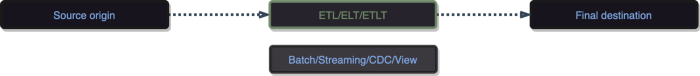

CDC变更数据捕获实施模式

在本文中,我想讨论实现 CDC 的几种不同方法,以及一些关键应用程序是什么以及 CDC 如何融入现代数据流架构的大局。有几种从数据库中提取变更事件的方法,每一种都有自己的优点和缺点。因此,让我们仔细看.

批处理与事件流区别?

随着数据成为现代企业中越来越重要的一部分,组织经常发现自己需要处理大量数据。处理数据的两种常见方法是批处理和事件流。批处理 批处理涉及通常在预定的时间间隔(例如每天或每周)内一次处理数据。 常用于不需.

数据管道设计模式

Apache Kafka在实时物流、运输行业运用

物流、航运和运输需要实时信息来构建高效的应用程序和创新的业务模型,通过数据流支持相关的决策、建议和警报。这篇博文探讨了 Kafka在USPS、瑞士邮政、奥地利邮政、DHL 和 Hermes 等公司的几.

cdc-file-transfer:从Windows同步文件到Linux的传输工具

这个存储库包含用于将文件从 Windows 同步和流式传输到 Linux 的工具。它们基于内容定义分块 (CDC),特别是 FastCDC,将文件分成块。谷歌开发了两个工具cdc_rsync和cdc_.

关于如何以及为什么需要函数式编程? - Merrick

让我们从一个例子开始:在 Advent of Code 2022 day 1 中,我们有一组数字的字符串,看起来像:10002000300040005000600070008000900010000我.

2023年流Stream预测 - tspann

Apache Pulsar、Apache Flink SQL as a Service、Apache Pinot等流Stream架构技术预测:Apache Pulsar2023年,Pulsar的新版本.

Apache Flink与Kafka Streams区别? - Gunnar

Apache Flink与Kafka Stream都能实现流处理,但在一些重要方面有所不同。下面是从用户的角度出发的,不涉及实现细节:支持的流平台不同 作为的Apache Kafka项目的一部分,Ka.

Java流比pyspark性能提高了几十倍 - Reddit

我试图在一些大 CSV 文件的每一行上运行一些自定义逻辑,大约 10 GB数据。尝试过 python 数据帧、python 中的多处理、pyspark。他们都没有在可接受的时间内完成。然后我发现了ja.

如何将Rust的“struct”转换为数据流?

当且仅当原始结构派生Serialize和Deserialize特征时,可以使用bincode将它们序列化为 binary-encoded Vec<u8>。在这里,我用一个元组结构MyStruct包裹了.

在 Data Lakehouse 中统一批处理和流处理

最近,我们在 ALTEN 的一位客户表示希望开始从他们的操作系统中提取和集中数据。从分析的角度来看,他们的信息环境处于未开发状态。这为创建集中式分析平台留下了许多架构选项。我们对数据处理的主要要求包括.

有状态流处理和流数据库两种数据处理方式比较

长期以来,在有状态流处理器和流数据库之间进行选择一直是一个有争议的问题。一个流处理应用程序是一个DAG(直接无环图),其中每个节点是一个处理步骤。你通过编写单独的处理函数来编写DAG,这些函数在数据流.

Java两张常用备忘录图

幽默:英语是自然Lambda的

oskardudycz/EventSourcing.JVM:JVM语言中事件溯源的示例和教程

事件溯源是一种设计模式,其中业务操作的结果存储为一系列事件。这是持久化数据的另一种方式。与仅保留最新版本的实体状态的面向状态的持久性相比,事件溯源将每个状态更改存储为单独的事件。谢谢你,没有业务数据丢.

使用 Postgres、Debezium 和 Kafka 流式传输数据

通过流处理,我们可以在数据可用时持续处理数据我们以事件流的形式从事件源(例如数据库)实时捕获数据,并将数据移动到目标系统(例如数据仓库和数据库)。什么是事件?事件就是你将数据概念化的时候。我这么说是什.

Apache Wayang :跨平台数据处理系统

Wayang 使用户能够在多个数据处理平台上运行数据分析。为此,Wayang 在现有平台之上提供了一个抽象,以便在任何平台集之上运行数据分析任务。因此,用户可以专注于其应用程序的逻辑,而不是底层平台的.

Golang的流式代码 - 0x46

Go 1.18 刚刚发布,这意味着 Go 现在正式支持泛型。出于好奇,我决定研究创建一个实现类似于 Java 流的库。我的简单实现的目标是支持使用两个操作处理切片的元素:映射和过滤。如果您只想查看代码.

在Go中使用泛型实现最小值和最大值函数 - gosamples

从slice中获取最小值和最大值是开发人员在日常编码中编写的一些最简单的函数。问题是,当你想从int和float64s这个slice中获取最小值或最大值时,1.18版本以前,你不得不为每个slice类.

在Golang中使用泛型实现“slice包含”检查函数

检查一个数组是否包含一个给定的值是一个流行的编程函数,在许多编程语言中都是原生实现的。在Go中,我们必须自己实现它,但由于新的泛型功能,我们可以编写一个单一的contains()函数,它将适用于任何类.

在Golang中使用泛型从任何map中获取键的slice

在Go 1.18之前,当你想从Go中的map中提取一个键列表时,你必须编写代码来迭代map并将键添加到一个slice中。从1.18起,有了新的泛型功能,你可以写一个单一的通用函数,从任何map中获取键.

在Golang中使用泛型实现slice排序 - gosamples

排序是新泛型功能的一个非常自然的用例。在Go中对slice进行排序是以前每次有新的slice类型时都要重新编写的事情之一。有时你会为两种不同的类型使用相同的代码。从Go 1.18开始,由于新的泛型功能.

在Golang中使用泛型实现slice过滤filter()函数 - gosamples

到目前为止,在 Go 中创建函数 filter() 是很困难的,它可以根据谓词的布尔值来过滤任何元素的列表。如果你知道列表的类型,这是有可能的。func filter(slice []string, .

使用Golang中的泛型创建“map”函数 - gosamples

map()函数是另一种函数式编程范式,由于新的泛型功能,它可以在Go中轻松实现。它的工作原理是应用一个函数,将单个slice元素作为参数,对其进行转换,并返回输出值,其中采取和返回的类型不一定相同。例.

在Golang中使用泛型reduce函数 - gosamples

reduce()函数是由 JavaScript 和 Python 等其他编程语言推广的函数式编程概念。它的工作原理是通过对数组中的每个元素应用一个产生部分结果的函数,将一个数组还原成一个单一的值。最后.