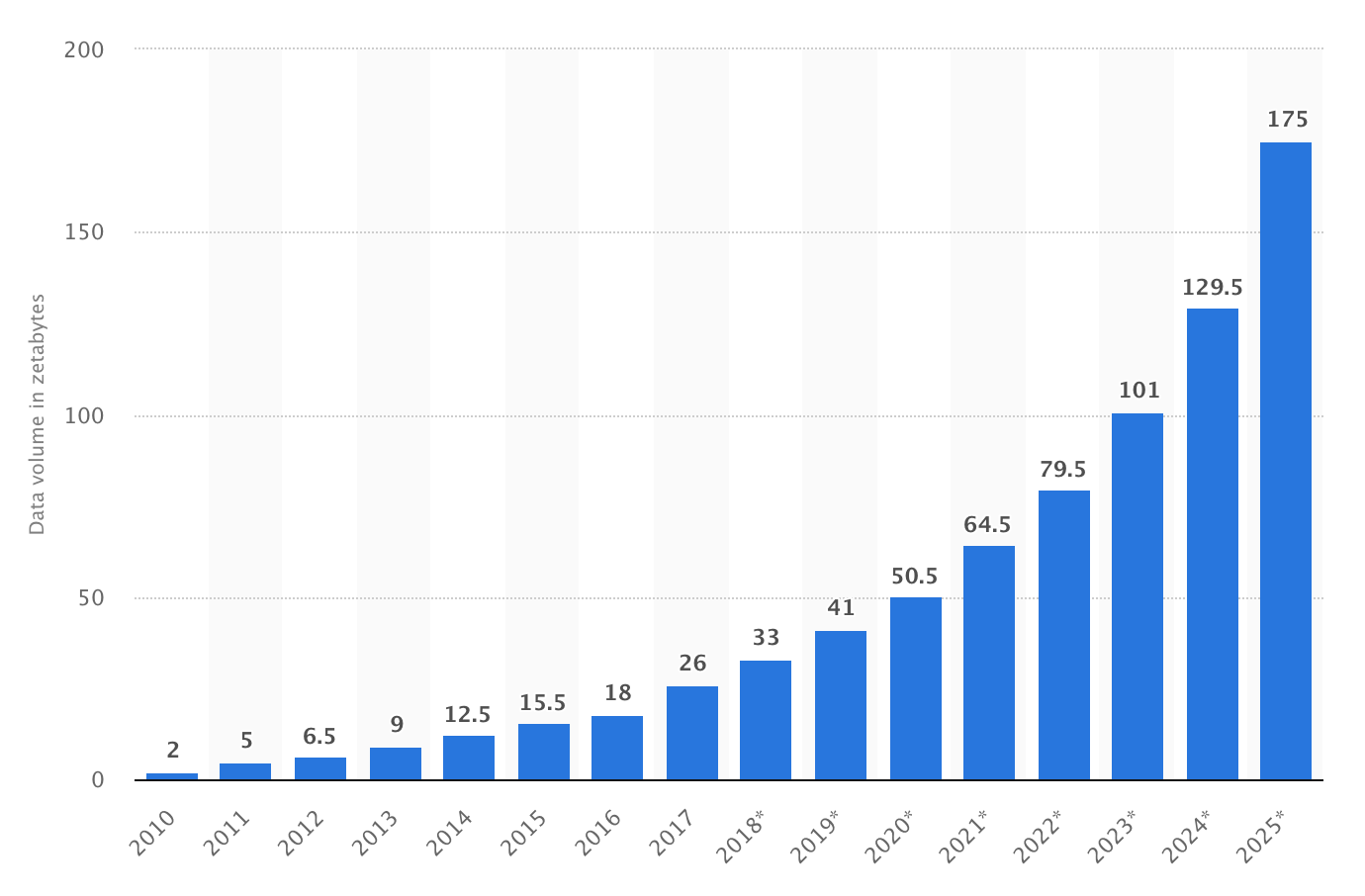

大数据量

十亿行挑战

让我们开启 2024 年真正的编码风格 —我很高兴宣布10 亿行挑战赛(1BRC),将于 1 月 1 日持续到 1 月 31 日。如果您决定接受的话,您的任务看似简单:编写一个 Java 程序,用于.

2023年游戏数据流的状况

这篇博文探讨了 2023 年游戏行业的数据流状态。包括来自 Kakao Games、Mobile Premier League (MLP)、Demonware / Blizzard 等的客户案例。休闲.

利用快速C++数据处理的Python API

ArcticDB 是一个为 Python 数据科学生态系统构建的高性能、无服务器 DataFrame 数据库。ArcticDB by Man Group一个Python API,利用快速C++数据处理.

OpenJDK使用Intel的x86-simd-sort将数据排序速度提高 7~15 倍

今年早些时候,英特尔发布了x86-simd-sort 作为使用 AVX-512 的超快排序库。当时流行的 Numpy 使用它时,他们发现 16 位到 64 位数据类型的排序速度提高了 10~17 倍。.

Apache Pinot、Kafka 和 Presto实现低延迟、高吞吐量的面向用户的分析

Apache Pinot 是一个实时分布式 OLAP 数据存储,专为低延迟、高吞吐量分析而构建,非常适合面向用户的分析工作负载。Pinot 携手 Kafka 和 Presto 提供面向用户的分析。如果.

流处理简介:比批处理更先进的大数据处理方式 - frankel

Java Stream和Collection比较:何时以及如何从Java API返回Stream而不是集合Collection? - TomaszKiełbowicz

向您展示一些可以非常方便地使用Java Stream流的场景以及如何使用它们的示例。本文基于标准Java库java.util.stream。它既与反应流无关,也与诸如Vavr之类的其他流实现无关。另外.

小巧易于使用的有磁盘支持的ArrayList -Bozho的技术博客

有时,列表List可能会变得太大而无法容纳在内存中,因此您必须采取一些措施以避免内存不足。做到这一点的正确方法是流传输–而不是将所有内容都放入内存中,您应该从源流传输数据并丢弃已经处理的条目。但是,在.

13种数据类型 - forbes

这十三种数据类型其实就是不同业务领域中的数据:1 . 大数据大数据被定义为:大量的数据实际上不适合标准(关系)数据库进行分析和处理,大数据是由人和机器生成的大量信息引起的过程。虽然'大数据'的定义可能.

使用Spring Boot RESTful Web服务实现流式数据 | Techshard

流数据是向Web浏览器发送数据的一种全新方法,可显着加快页面加载速度。通常,我们需要允许用户在Web应用程序中下载文件。当数据太大时,提供良好的用户体验变得非常困难,使用StreamingRespon.

Spring Boot + JPA实现MySQL批量更新源码 - github

数据表每天五千四百万数据,,如何汇总

mysql数据表table1每天5千4百万数据,十张分表(或者五十张分表),目前还未确定分表数,数据量是确定了,根据表中四个字段(c1,c2,c3,c4)汇总,四个字段相同就可合为一条,累加金额。目前.

Java 大数据量处理问题

我先描述下我的需求吧:1.每秒有200-300条数据从短信网关上来。2.每条短信在处理逻辑中需要二次确认,所以这些短信就要被当做原始记录(对象)保持起来3.二次确认可能需要很长时间,比如30分钟,超过.

关于库存查询与领域建模

本人正在做库存管理,在看了大量设计模式,ddd,企业设计模式相关资料,并基本参考了dddsample后,使用spring mvc+spring+hibernate,对库存管理系统进行了初步的领域建模(.

有在实际项目中用derby的吗

打算在一个实际项目中用derby来代替mysql,数据量大概是几百万吧。以前用过mysql感觉性能上比较保险,如果用derby性能如何,有实际用过的说说.

百万数据如何高效率导入数据库

公司有这么个需求,有一些TXT文本文件,每个文件里至少有100万行以上的数据(50M以上)。要求用JAVA写一个程序把TXT里的数据读取出来插入到数据库中的表中去。设计成B/S结构。要求性能足够的高。.

老声常谈,分页查询的实现就是不分页

分页查询是经常遇到的问题,几乎每个项目都会遇到,如此常见的问题,我们的数据库却没有提供现成的解决方法,例如Oracle提供Rownum字段,SQLServer提供TOP关键字,MySQL提供Limit.

jsp页面需要进行大数据量的操作????????????急

有一个jsp页面需要进行大数据量的操作,比如在数据库中插入10万条记录,可能要消耗很长时间,比如说1小时,或者更长如果使用jsp实现,等待这么长时间肯定会页面超时,session也会失效,而且页面也不.

关于大数据量的处理

大家都知道,在实体Bean的Home接口中可以定义Finder方法进行查找,返回远程接口或本地接口的实例或者是集合。但是如果查找到的结果非常大,比如说10万条,就会出现问题了。这时该怎么处理?谢谢!.