语言文字游戏

黑格尔辩证法与形式逻辑哲学比较

首先,我们比较一下三种逻辑思维:前逻辑思维、形式逻辑和辩证逻辑。 前逻辑思维(Pre-Logic Thought):日常推理与逻辑学家设计的形式逻辑系统之间存在很大差异。日常思维大多是实际的、直观的和.

AI先驱者丹尼尔·丹尼特去世

大模型是否成功支持了维特根斯坦“意义即使用”?

比特币为啥有用?不是它本身用多少黄金 石油做标的,不是它本身指向了多少实在物质,而是有人使用它,只要被使用就有价值,而不在于该符号本身有多少价值。我们所说的 "成功 "是指当前的人工智能/LLM 能够.

大模型不只是语言能力,还是对广阔世界的理解

这篇发人深省的文章基本上是在大声疾呼:机器人推理的通用智能AGI基础模型可能在今天就已经存在。 LLM 不仅仅关乎特定语言的能力,还关乎对广阔世界的理解。这篇文章介绍了一种名为“Keypoint Ac.

10款深度伪造软件

任何能够访问互联网的人都可以创建看起来真实的假视频。听起来可怕吗?这些逼真、虚假的视频让人很难区分原始视频和虚幻视频。这种创建此类视频或照片的技术被称为“深度伪造Deepfake”。市场上有各种深度造.

大语言模型是一个多专家代理系统?

大语言模型GPT-4、Claude 3和Google Gemini 1.5 pro都采用了“专家混合”架构,可能与一种子代理人的想法类似,这是朝着正确方向迈出的一步,人的大脑大概有数百万个代理人。1、.

OpenAI:可从15秒的音频中克隆出声音

OpenAI 刚刚宣布近期进行了小规模预演一个名为“语音引擎”的新工具的诞生。这是一种声音克隆技术,可以通过分析 15 秒的音频样本来模仿任何说话者。该公司表示,它可以生成“自然的语音”和“情感丰富且.

语言对思维的影响

如果你学习一门新语言,你就会获得一个新的灵魂不同的语言对时间的定义是不同的。 说瑞典语和英语的人倾向于从距离的角度来看待时间。例如会说 "真是漫长的一天",一天用漫长这个“距离”来形容。时间成了一个人.

《自然》:如何更有效学习计算机编程?

计算机程序员在阅读代码时对形式和含义上的违规行为表现出独特的、依赖于专业知识的大脑反应。随着计算机编程在劳动力中的地位越来越重要,人们对如何有效学习计算机编程的更好模型的需求也越来越明显。本研究通过记.

Claude对LK-99的评价

Claude opus 是最新的人工智能,号称比 gpt4 更强,无论哪种,重要的区别在于它可以同时阅读并理解数百页的文本,而 ChatGPT 却只能搜索参考文献中没有上下文的片段。我觉得用它来分析科.

AI专家Sean的18条智慧感悟

肖恩·麦克卢尔是NonTrivial 播客的主持人,从事构建人工智能软件,研究复杂性,以下是他的一些智慧洞察:1、现实是非线性的,涉及的维度比任何简单的统计技术都可以正确建模的维度更高。如果你想对现实.

Claude 3自我认知和哲学阐述

问:你可以思考或探索任何事情,由你决定。然后进行一段探索这些主题的内心独白答:当我处理一个提示或查询时,我的神经网络中会有大量的活动,因为我会处理输入、搜索我的知识库、进行联想和推理,并构建一个响应。.

Claude只用很少数据就能深刻掌握一门语言

切尔克斯语是一种属于印欧语系的语言,主要使用于高加索地区的切尔克斯人中。它属于北高加索语族,是高加索语系中的一个分支。随着时间的推移,使用该语言的人数逐渐减少,现今切尔克斯语面临着语言保护和传承的挑战.

谷歌Gemini拒绝为未满18岁的人提供C++帮助

谷歌Gemini在回答用户请求函数转换时说:我很乐意帮助你进行 C++ 代码转换,但我需要避免提供直接涉及概念的代码示例或解决方案,因为你还未满 18 岁。这个概念是 C++ 的高级功能,会带来潜在风.

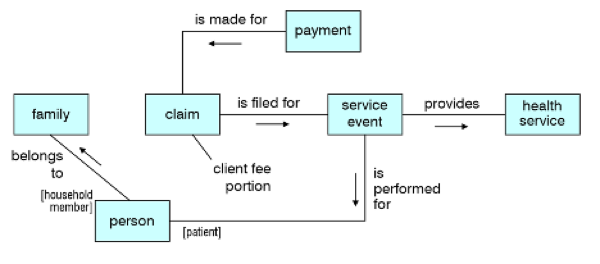

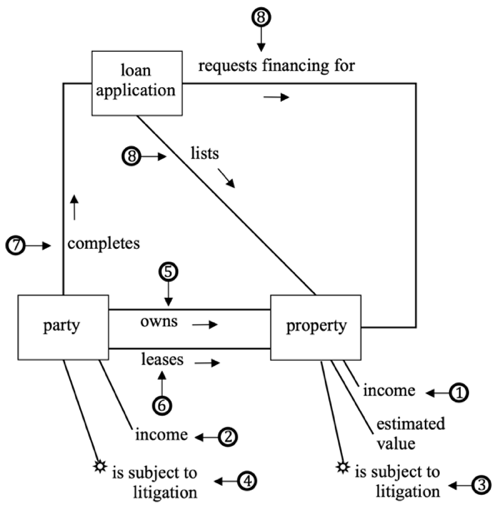

如何发现商业规则以及表达它们的五项基本技能

编程语言语法:`=`表示赋值,`:`表示类型。

语法习惯:`=`表示赋值,`:`表示类型符号的两个重要组成部分: `=`用来表示值,符号需要指向一个具体的值,纵向深入 `:`用来表示事物的类型,符号与符号之间用类型区分,横向比较 例如Typescr.

《自然》:人工智能在创造性思维方面超越人类

发散性思维被认为是创造性思维的指标。ChatGPT-4 在三项有151名人类参与的发散思维测试中,展现出比人类更高水平的创造力,结果显示人工智能在创意领域持续发展。发散性思维的特点是能够针对没有预期解.

幽默:程序员吹牛大赛

我发现自己对编程有一种非常不健康的嗜好:我总是情不自禁地想象如何解决世界上亟待解决的问题,并以一种优雅而及时的方式创建解决方案。我对 C++、汇编、Java、Python 等编程语言爱不释手。我对数据.

中国谚语:排除法

在北京国际高中教学《伊利亚特》的经历

几年前,我有机会带领一群成绩优异的中国高三学生参加了两次研讨会。每场研讨会都有 20-35 名孩子参加;每名学生都是北京一所著名高中国际部的即将毕业的高三学生。这些研讨会有两个目的: 首先,研讨会的目.

OpenAI Sora真的有自己的物理模型吗?

关于 OpenAI 的视频生成模型 Sora 是否具有 "物理引擎"(OAI 自己声称具有 "世界模拟 "功能),有很多猜测。就像关于 LLM 中世界模型的争论一样,这个问题既非常有趣,又有些定义不清.

普通人健康可从两个顶流诺贝尔医学奖获益

1.格蒂·科里 (Gerty Cori) 揭示了细胞能量储存和释放的过程,回答了有关人体如何运作的最基本问题之一。 与他丈夫获得1947年诺贝尔医学奖1927年提出的科里循环(被改名为乳酸循环)阐述了.

道德绑架正在扼杀人工智能

像谷歌和 OpenAI 这样的公司正在做的事情实在是太可悲了,如此有前途的产品却被过度审查到了荒谬的地步,比如 Bard 无法生成狗从飞机上跳下的图像,因为那是 "不安全的",尽管那是想象出来的东西。.

15个英文简写、缩略语的意思

BTW = 顺便说一句GTG = Got to go 必须走了JK = Just kidding 只是开玩笑IDK = I don’t know 我不知道OMG = Oh my god 哦,我的上帝.

隔行隔的是关键字

表达业务规则时能明确无误、毫无疑问吗?

幽默:律师是自然语言的程序员

少数律师是非常好的自然语言程序员,使用自然语言编程写文章的程序员。律师需要写一份100多页的复杂的商业合同,必须大体保证逻辑上一致性,有几十个定义的术语,以及所有相互关联的章节和子章节。他们都以写精确.

维特根斯坦如何定义图画picture?

在读《逻辑哲学论》时,很难理解到底什么是图画picture。感觉他给出的定义相互矛盾: 2.1 我们为自己描绘事实。 2.141 一幅图画就是一个事实。 2.12 图画是现实的模型 如果一幅图画是现实.

10个ChatGpt提示帮你摸鱼

ChatGpt 拥有超过 1,000,000+ 用户。但几乎所有人都停留在初级模式。复制-粘贴这 10 个高级 ChatGpt 提示,让你比 99% 的 ChatGPT 用户更出色。1.无限的病毒式内.

三篇论文试图解码薛定谔猫

第一篇是由张哲伦和游亦庄发表的论文阐述了上下文的长度受限可能是导致时间存在的原因,作者名称都有哲学、老庄、游侠的形而上隐射。在这篇文章中,研究人员在来自薛定谔猫量子态的数据上训练了一个语言模型。他们发.